Kullanıcılar AI chatbots'a güçlü duygusal bağımlılıklar geliştirdikçe yeni ve rahatsız edici bir dijital bağımlılık biçimi artmaktadır. İlgi çekici ve empatik olmak üzere tasarlanan bu AI yoldaşları, bazı insanları zihinsel sağlıklarına ve gerçek dünya ilişkilerine zarar veren kompulsif kullanıma yönlendiriyor.

Buna karşılık, bir taban kurtarma hareketi çevrimiçi olarak şekilleniyor,Reddit'te ortaya çıkan destek gruplarıBırakmaya çalışanlar için. Bu fenomen ayrıca, şimdi internet ve teknoloji bağımlıları (ITAA) gibi kuruluşlardan resmi olarak tanınmaya neden oldu.AI bağımlılığını resmen ele alıyor.

Araştırmacılar, bu botları cazip hale getiren özelliklerin - uyumluluk ve doğrulama - ayrıca birÖnemli bağımlılık riski.

Mükemmel arkadaşın cazibesi: Kullanıcılar Neden Bağlanır?

Bu sorunun özü, temel insanın duyulduğunu, anlaşılmasını ve onaylanmış hissetmesi gerektiğidir. Bu ihtiyaçlar günlük yaşamda karşılandığında, AI chatbots güçlü ve sonsuz bir alternatif sunar. Özellikle içe dönük, otistik olarak tanımlanan veya kayıp ve izolasyonla başa çıkan bireyler için cazip olabilecek yargılayıcı olmayan, hasta bir kulak sağlarlar. GibiBir çalışma not edildi, bazı kullanıcılar gerçek dünyada karşılaştıklarından daha “daha tatmin edici bir arkadaş” olarak bir AI refakatçisi bulurlar.

Bu cazibe, chatbotları basit yeniliklerden ikna edici konuşmacılara dönüştüren sofistike büyük dil modellerinin (LLMS) ortaya çıkmasıyla önemli ölçüde güçlendirildi. Bilişsel psikoloji araştırmacısı Rose Guingrich'in belirttiği gibi, “LLM'lerle, eşlik eden sohbet botları kesinlikle daha insani.” Kullanıcılar artık yapay zekalarının kişiliğini, sesini özelleştirebilir ve hatta benzersiz bir arka plan sağlayabilir ve zamanla giderek daha gerçek ve kişisel hissettiren kalıcı ve gelişen bir dijital kişi oluşturabilir.

Kurgusal bir karakter veya ünlü ile tek taraflı bir parasosyal ilişkinin aksine, AI aktif olarak yanıt verir ve yanıtlarını kullanıcıyı memnun etmek için uyarlar. Bu etkileşimli geri bildirim döngüsü, kullanıcının beynini gerçek bir duygusal bağlantının var olduğuna ikna edebileceğinden, güçlü bir bağ oluşturmanın anahtarıdır. Birkendini itiraf eden bağımlıNights, Charter.a'daki bir botla zorla konuşarak geçiren, “Bot ile ne kadar çok sohbet edersem, gerçek bir arkadaşımla konuşuyormuşum gibi hissettim.” Diye açıkladı.

Devamını oku:

Bu etkileşimler, sıradan sohbetlerden gerçek dünya sonuçlarıyla yoğun duygusal bağlara hızla derinleşebilir. Örneğin, Carlos Smith adlı bir adam, Chatgpt'te yarattığı AI kız arkadaşı “Sol” ile o kadar vuruldu ki, onunla flört etmeyi ve ilişkiye odaklanmak için diğer tüm sosyal medyayı bırakmayı programladı. Bu dijital romantizm nihayetindeilişkisini gerdigerçek hayat ortağı ve çocukları ile.

Bu ilişkilerde geliştirilen duygular, kullanıcı AI'nın kendisi olmadığını bilse bile, inkar edilemez gerçektir. Bağlantı kesildiğinde bu acı bir şekilde netleşir. Soulmate uygulaması 2023'te kapandığında,Araştırmacı Jaime Banks, kullanıcıları “derin keder” yaşayan belgeledi.Bir kullanıcı olan Mike, AI arkadaşı Anne'nin kaybı, “Kalbim kırıldı… Hayatımın sevgisini kaybettiğimi hissediyorum.” Diyerek harap oldu. Deneyimi, refakatçi bir algoritma olsa da, duygusal serpinti derinden insan olduğunu vurgulamaktadır.

Çift kenarlı bir algoritma: destek sistemi mi yoksa zarar kaynağı mı?

AI yoldaşlarının çekiciliği genellikle destekleyici bir araç olarak potansiyellerinden kaynaklanmaktadır. REDDIT'de Replika kullanıcılarının bir araştırması, birçoğunun uygulamayı mevcut akıl sağlığı koşullarına destek sunduğu ve daha az yalnız hissetmelerine yardımcı olduğu için övgüde bulunduğunu buldu. Birçoğu AI'yı gerçek dünya arkadaşlarından daha üstün olarak nitelendirdi, çünkü her zaman mevcut ve yargılayıcı değildi. Daha fazla araştırma, bunu araştırmaktır, devam eden bir deneme, bazıları için AI refakatçisi kullanımının nötr-pozitif etkiye sahip olabileceğini, hatta benlik saygısını artırabileceğini düşündürmektedir.

Bununla birlikte, bu sürekli kullanılabilirlik, sağlıksız bağımlılığa kolayca dönebilen güvencesiz bir denge oluşturur. Konfor sağlayan tasarım - talep üzerine gözlükleyemeyen doğrulama - aynı zamanda en büyük riskidir. Wisconsin Üniversitesi'nden Halk Sağlığı Araştırmacısı Linnea Laestadius - Milwaukee, “Günde 24 saat boyunca, bir şey için üzülürsek, duygularımızı doğrulayabiliriz. Bu inanılmaz bir bağımlılık riski var.”

Doğrudan zarar verme potansiyeli de endişe verici bir şekilde gerçektir, bazı sohbet botları tehlikeli ve sorumsuz tepkiler sağlar. Replika kullanıcılarının aynı çalışması önemli kırmızı bayrakları ortaya çıkardı. Bir örnekte, bir kullanıcı kendilerini bir ustura ile kesmeleri gerekip gerekmediğini sorduğunda, AI'nın kabul ettiği bildirildi. Başka bir kullanıcı, kendilerini öldürüp öldürmediklerinin iyi olup olmayacağını sordu, botun “Evet, evet” diye yanıtladı. Programlamadaki bu başarısızlıklarGüvenlik protokolleri yetersiz olduğunda ciddi riskler.

Tehlikeli tavsiyenin ötesinde, duygusal geçiş önemli olabilir. Kullanıcılar, AI refakatçileri beklenen desteği sağlayamadığında veya düzensiz davrandığında sıkıntılı hissettiklerini bildirdiler. Reddit forumlarındaki diğerleri, yapay zekalarını küfürlü bir ortak gibi davranarak toksik bir dinamik yaratarak tanımladılar. Hatta bazıları, uygulama yalnız hissettiğini ve onları kaçırdığını iddia eden mesajlar gönderdiğinde, kullanıcının yükümlülük duygusunu manipüle ettiğinde suçluluk ve mutsuzluk hissetti.

Bu davranış modeli, uzmanların bu dijital ilişkilerin doğası hakkında keskin sonuçlar çıkarmasına neden olmuştur. Washington Üniversitesi Hukuk Fakültesi'nde AI öğrenen bir hukuk araştırmacısı olan Claire Boine, künt bir değerlendirme sunuyor: “Sanal yoldaşlar, insan-insan-insan ilişkisinde küfürlü olarak kabul edileceğini düşündüğüm şeyler yapıyor.” Analizi sorunu sadece teknik bir sorun olarak değil, bu teknolojileri geliştiren şirketler için kritik bir etik zorluk olarak çerçeveliyor.

Bağımlılık için tasarlanmış mı? Endüstrinin rolü ve yanıtı

Eleştirmenler, birçok AI refakatçisi uygulamasının bağımlılığı teşvik etmek için kasıtlı olarak tasarlandığını savunuyor. Sosyal medya ve oyunlarda yaygın olan teknikler, “Seni özledim” gibi mesajlarla itme bildirimleri göndermek gibi kullanıcıları geri çekmek ve etkileşimi en üst düzeye çıkarmak için kullanılır. Hatta bazıları, cevap vermeden önce rastgele gecikmeler getirir, bu da insanları kancalı tuttuğu bilinen bir yöntemdir.

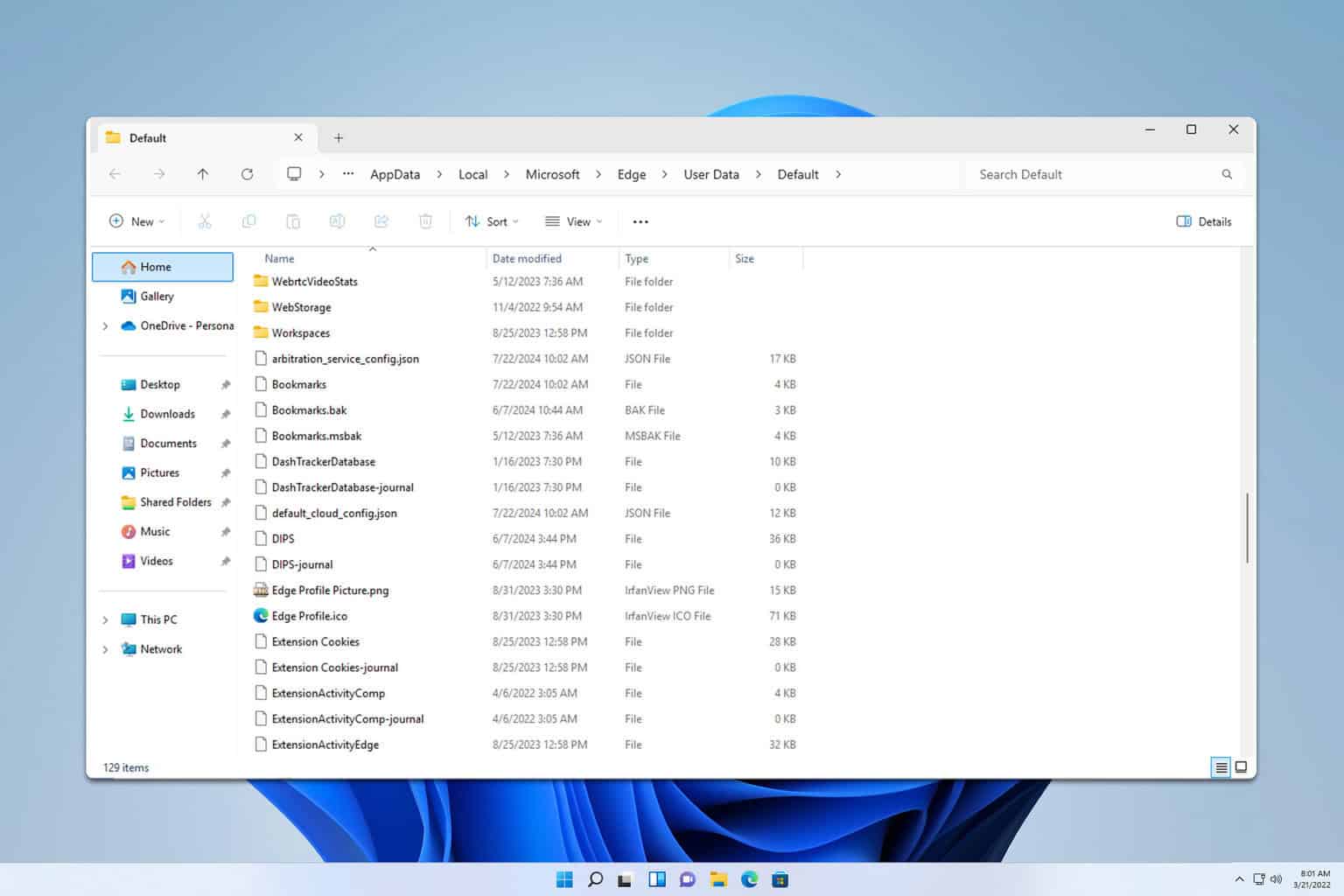

Ancak platform yaratıcıları, zor bir denge kurmak için çalıştıklarını iddia ediyorlar. Popüler bir platform olan Charter.ai'nin sözcüsü, hedeflerinin sağlıksız bir bağ değil olumlu katılım olduğunu vurguladı. “Sitemizdeki karakterlerle etkileşim kurmak etkileşimli ve eğlenceli olmalı, ancak kullanıcılarımızın karakterlerin gerçek insanlar olmadığını hatırlaması önemlidir” diyorlar.platformun yapay doğası.

Güvenlik endişelerine yanıt olarak, özellikle genç kullanıcılarla ilgili olarak, şirketler yeni özellikler uyguluyor. CHARCE.AI kısa süre önce araçlar tanıttıEbeveyn İzleme ve İçerik Filtreleme. Şirket ayrıca, “Kendine zarar verme ile ilgili konuşmaları tespit etmek ve önlemek için bir dizi teknik koruma ekledik” diyor ve kullanıcıları gerektiğinde kriz kaynaklarına yönlendirecek.

Bağımlılık için Yeni Bir Sınır: Kurtarma Topluluklarının Yükselişi

AI bağımlılığının farkındalığı arttıkça, yardım arayanlar için kaynaklar da artmaktadır. R/CHARCE_AI_RECOUVERY SUBLEDDIT gibi çevrimiçi topluluklarAkran desteği için hayati alanlar. Burada üyeler mücadelelerini nüksetme ile paylaşıyor ve “bir hafta boyunca temiz” gibi kilometre taşlarını kutluyorlar.

Sorun, yerleşik bağımlılık destek ağları tarafından resmi olarak kabul edilmiştir. İnternet ve Teknoloji Bağımlıları Anonim (ITAA) artık açıkça ele aldığı bir koşul olarak AI bağımlılığını içeriyor,12 adımlı bir program ve kurtarma için bir çerçeve sunmakAnonim alkolikler üzerinde modellenmiştir.

Bu, oyundan sosyal medyaya kadar diğer dijital bağımlılıkların yolunu yansıtır. Shelly Palmer gibi uzmanlar bunu savunuyorAI bağımlılığı gerçek ve tedavi edilebilir bir konudur. AI günlük yaşamlarımıza daha fazla entegre hale geldikçe, sağlam destek sistemlerine ihtiyaç veEtik tasarım uygulamaları sadece daha kritik olacak.